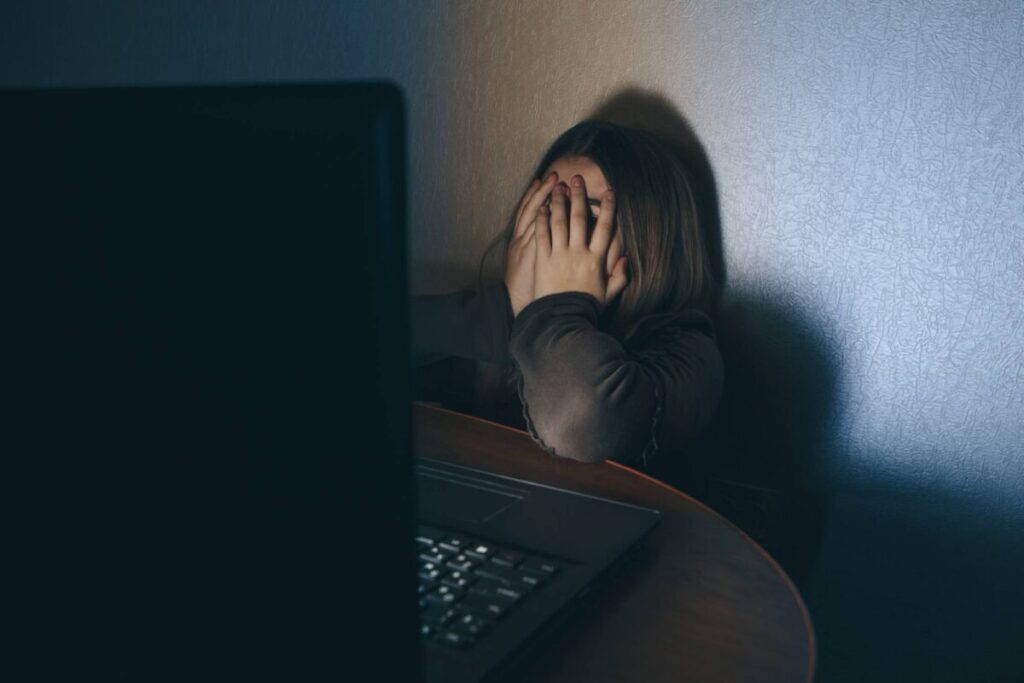

CÓRDOBA.-El Juzgado de Control de Violencia Familiar N° 1 de Córdoba confirmó la elevación a juicio de un joven que, mediante inteligencia artificial (IA), manipuló imágenes de sus compañeras de colegio y las difundió en sitios pornográficos. Las víctimas denunciaron el hecho en tribunales.

El episodio ocurrió el año pasado en el Instituto Superior de Comercio Manuel Belgrano, dependiente de la Universidad Nacional de Córdoba (UNC). El imputado, de 19 años, está acusado de lesiones graves calificadas por motivos de género.

Según la investigación, el joven aplicó técnicas de intercambio de rostros (conocidas como face swapping) con IA y superpuso los rostros de varias estudiantes, de entre 15 y 16 años, en cuerpos desnudos extraídos de sitios pornográficos. Luego divulgó esas imágenes.

El fiscal de la causa, Pablo Cuenca Tagle, sostuvo que la conducta del acusado provocó lesiones psicológicas graves en las adolescentes. Todas son alumnas del Belgrano y, tras el hecho, sufrieron cambios en sus rutinas, baja en el rendimiento escolar y deportivo, desgano, vergüenza y temor.

La jueza de Control, María Celeste Orta Córdoba, confirmó la elevación a juicio y rechazó la oposición de la defensa, que todavía puede apelar ante la Cámara de Acusación.

José Dantona, abogado de tres de las víctimas, señaló las dificultades para encuadrar el caso, ya que el face swapping no está tipificado como delito. Por eso la imputación es por lesiones graves calificadas por motivos de género. También precisó que, si bien algunas imágenes fueron eliminadas, otras siguen disponibles en internet asociadas a los nombres de las chicas, lo que genera un daño permanente.

En el colegio hubo contención inicial para las alumnas, pero, según Dantona, surgieron dificultades para gestionar la situación porque el imputado continuó asistiendo a clases en otros horarios, lo que no evitaba que se cruzaran.

En paralelo, el diputado nacional por Córdoba Juan Brügge impulsó un proyecto de ley para el uso responsable de la IA, con el objetivo de proteger derechos ciudadanos y garantizar una aplicación ética y transparente. La iniciativa apunta a identificar riesgos potenciales de la IA en relación con los derechos humanos y se basa en legislaciones de otros países y en criterios técnicos y jurídicos de expertos. Incluye un sistema de multas y la posibilidad de acciones judiciales directas para quienes resulten afectados. Alcanza a proveedores, responsables del despliegue, importadores, distribuidores, fabricantes y usuarios de IA en el país.

//

//